À l’occasion de l’AWS Summit Paris 2026, nous avons eu le plaisir d’être présents avec notre stand, d’échanger avec de nombreux acteurs de l’écosystème… mais aussi de prendre un peu de recul en assistant à plusieurs conférences particulièrement marquantes.

Au fil des sessions, une conviction s’est imposée : nous assistons à un véritable changement de paradigme. Entre montée en puissance de l’IA agentique, transformation des pratiques DevOps, enjeux de souveraineté et abstraction croissante des infrastructures, le rôle des équipes tech évolue en profondeur.

🎥 Retour en images sur notre présence à l’AWS Summit Paris 2026

Pour revivre les temps forts de l’événement (notre stand, les échanges avec l’écosystème et l’ambiance sur place), nous vous avons préparé un récap vidéo.

Une vision globale : souveraineté, IA et transformation du cloud

Keynote AWS Summit 2026 : une accélération sans précédent

Cette édition marque les 20 ans d’AWS, avec un message clair : l’innovation continue reste guidée par l’obsession client.

Quelques chiffres clés illustrent cette dynamique :

- 6 milliards d’euros investis en France

- 100 % de disponibilité sur la région Paris depuis 8 ans

- 70 % des entreprises constatent des gains de productivité grâce à l’IA

Mais derrière ces chiffres, c’est surtout une transformation des usages qui se dessine.

L’IA devient un levier central :

- développement accéléré (Kiro)

- environnements de travail augmentés (Amazon Q Spaces)

- modernisation massive (AWS Transform)

Et surtout, une nouvelle génération d’agents fait son apparition :

- DevOps Agent

- Security Agent

- agents autonomes capables d’agir directement sur les systèmes

Souveraineté numérique : un enjeu désormais structurant

La question de la souveraineté était au cœur des discussions.

AWS distingue deux dimensions :

- souveraineté des données (localisation, accès)

- souveraineté opérationnelle (résilience, indépendance)

Plusieurs éléments forts ressortent :

👉 Le CLOUD Act, souvent mal compris Même dans le pire scénario, seules des données chiffrées seraient accessibles — donc inutilisables sans les clés.

👉 La technologie Nitro Une isolation matérielle garantissant un zero operator access : même AWS ne peut pas accéder aux données en clair.

👉 L’European Sovereign Cloud Une évolution majeure avec :

- infrastructure entièrement européenne

- gouvernance locale

- autonomie complète vis-à-vis des autres régions

Message clé : 👉 innovation et souveraineté ne sont plus opposées, mais deviennent configurables selon les besoins.

Comprendre la complexité pour mieux la maîtriser

L’aventure d’une requête HTTP ou le chemin de la vie des développeurs

Cette conférence propose une lecture presque philosophique de notre métier.

En retraçant le parcours complet d’une requête HTTP - du clavier jusqu’à l’infrastructure - elle met en évidence une réalité incontournable : 👉 la complexité est partout, et elle est irréductible.

La réponse proposée : le profil en “T”

- expertise forte sur un domaine

- compréhension transverse des autres couches

Cette grille de lecture éclaire parfaitement les autres sujets du Summit : si tout devient plus complexe, alors il faut mieux s’outiller… ou déléguer.

L’IA agentique : du concept à la production

Créer son agent IA avec Bedrock AgentCore

Cette session montre comment les agents IA s’intègrent directement dans les workflows de développement.

Branché à GitLab, un agent peut :

- lire une issue

- comprendre le besoin

- proposer une implémentation via une merge request

On passe d’un assistant passif à un acteur du cycle de développement.

Du ticket au déploiement : l’automatisation devient orchestration

Une autre démonstration particulièrement marquante illustrait un cas d’usage très concret : automatiser entièrement le cycle de vie d’un ticket, de sa création jusqu’au déploiement en production.

Le workflow présenté est simple en apparence, mais radical dans ses implications :

- Création d’un ticket (Jira, GitHub Issues…)

- Assignation a un agent comme un développeur

- Déclenchement automatique d’une fonction AWS Lambda

- Déploiement d'agent qui réalise le ticket et soumettent une MR

- Boucle de feedback en commentant la MR du ticket

- Si commentaires sur la MR alors redéploiement d'agents

L'agents Strands entre alors en action :

- compréhension du besoin

- possibilité de déployer des sous-agents spécialisés

- navigation dans le repository

- modification directe des fichiers Terraform

Dans ce type de workflow, la structure du ticket devient un puissant levier de contrôle.

Les spécifications sous forme de Bullet Points sont recommandées.

Exemple de structure recommandée pour des tickets "AI-Ready"

### 🎯 Objectif: Une phrase simple décrivant le résultat final attendu.### 🛠 Spécifications (Bullet Points)### 🚫 Contraintes & Limites### ✅ Critères d'acceptation

Une fois la MR validée, le pipeline CI/CD prend le relais :

- Terraform Validate

- Terraform Plan

- Terraform Apply manuelle

L’intervention humaine est volontairement limitée à deux étapes majeures :

👉 la review de la Merge Request

👉 la review du Terraform Plan

Ce cas d’usage illustre un basculement majeur : 👉 on ne parle plus d’automatisation de tâches, mais d’orchestration intelligente de bout en bout

Kiro IDE : vers des systèmes multi-agents orchestrés

Une autre session a mis en lumière Kiro, un environnement conçu pour orchestrer des systèmes multi-agents.

La Kiro CLI se distingue par une approche très granulaire :

- injection de contexte dynamique (knowledge add)

- modes de raisonnement (Thinking, Tangent)

- gestion native des tâches et checkpoints

Mais le point clé reste l’architecture multi-agents.

Plutôt qu’un agent unique surchargé, Kiro propose : 👉 une constellation d’agents spécialisés, orchestrés par un agent central.

Exemple présenté :

- un agent pour les données

- un agent météo

- un agent métier

- un orchestrateur qui supervise et valide

Ce modèle centralisé permet :

- de réduire les hallucinations

- de mieux contrôler les flux

- d’améliorer la fiabilité globale

Pourquoi le multi-agent plutôt qu'un seul "super" agent ?

La spécialisation réduit la charge cognitive du modèle : en limitant le contexte à l'essentiel, on augmente la densité d'attention et on élimine le "bruit" informationnel.

Cette architecture multi-agents garantit une plus grande précision, là où un agent unique s'égarerait dans une masse de données trop complexe.

Du Single-Agent System (SAS) au Multi-Agent Systems (MAS)

Représente l'intelligence collective orchestrée.

On découpe une tâche complexe en plusieurs sous-tâches plus simples.

Plus fiable, nécessite d'ajouter des compétences modulaires.

Performance accrue, travail en parallèle et en asynchrone.

Coût plus important.

👉 En 2026, passer à des systèmes multi-agents n’est plus une option, mais une nécessité pour la production.

AWS Transform : industrialiser la migration et la modernisation

AWS Transform pousse encore plus loin cette logique.

Constat de départ :

- 70 % des entreprises sont “cloud-first”

- mais 70 % des apps ont plus de 20 ans

L’agent vient combler ce gap.

Cas concret :

- 400 VMs analysées en moins de 5 minutes

- plan de migration en 100 minutes

- conversion automatique vers des ressources AWS

Côté modernisation :

- mise à jour de runtimes

- refactoring de code

- migration de SDK

Résultat impressionnant : 👉 plus de 10 000 applications modernisées en interne chez Amazon 👉 4 500 années de développement économisées

Vers des opérations autonomes

AIOps : de l'alerte à la résolution

Le DevOps Agent illustre une évolution majeure : 👉 l’IA ne se contente plus d’analyser, elle agit.

Le retour d’expérience de Kering est parlant :

- -80 % de temps de troubleshooting

- 30 % de PR générées automatiquement mergées

- requalification d’incidents critiques

On entre dans une logique d’opérations semi-autonomes.

Ce type d’automatisation trouve naturellement sa continuité dans les pratiques AIOps, où l’IA ne se contente plus de produire du code, mais intervient directement sur les systèmes en production.Industrialiser les agents : scalabilité, isolation et coûts

IA agentique en SaaS : passage à l’échelle

Une session particulièrement technique a abordé un enjeu clé : 👉 comment faire passer les agents de prototypes à des systèmes SaaS industrialisés.

Le framework Strands y joue un rôle central :

- gestion de la logique métier

- séparation avec l’infrastructure (AgentCore)

Trois modèles d’architecture multi-tenant émergent :

- Pool (mutualisé) : coût minimal, isolation logique

- Silo mémoire : compromis performance / isolation

- Silo complet : isolation totale pour les environnements critiques

S3 Vector Store : un changement de paradigme

L’une des annonces marquantes concerne l’utilisation de S3 comme base vectorielle.

Avantages :

- latence < 100 ms

- coût jusqu’à 90 % inférieur aux solutions classiques

- simplification de l’architecture RAG

FinOps des agents : une nécessité

La gestion des coûts devient critique.

Une architecture type se dessine :

- export des coûts (CUR)

- traitement via Lambda

- stockage dans DynamoDB

- visualisation avec QuickSight

👉 Objectif : détecter rapidement tout comportement anormal (agent “fou”, boucle infinie, etc.)

Kubernetes comme plateforme centrale

Workshop : agents IA sur EKS

Le workshop montre une approche pragmatique : déployer des agents directement sur Kubernetes.

Avantage :

- pas de nouveau service à introduire

- cohérence avec l’existant

- maîtrise opérationnelle

Cela oppose deux stratégies :

- AgentCore (managé)

- EKS (intégré)

Focus : Amazon EKS au cœur des transformations

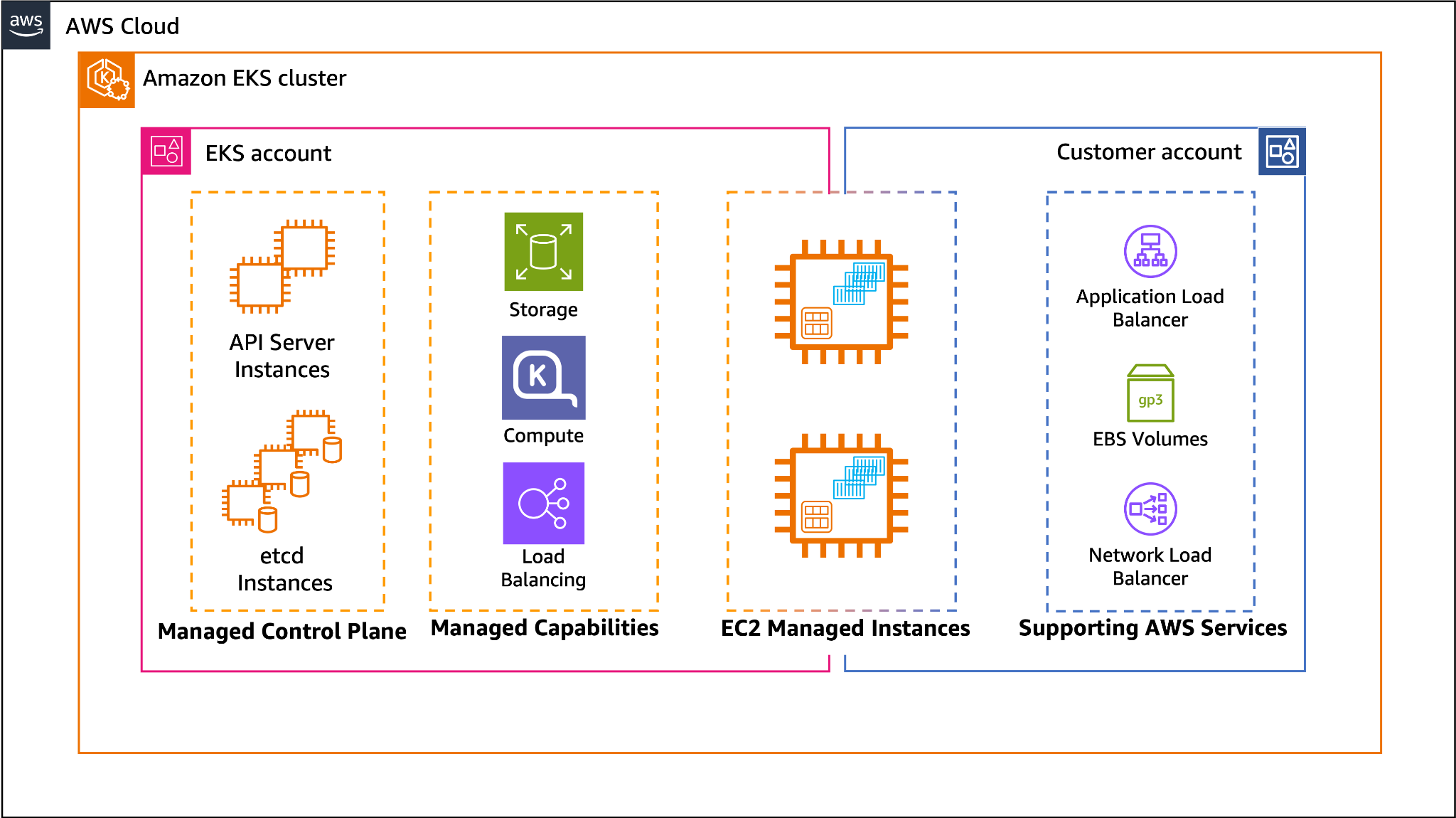

Depuis son lancement en 2018, Amazon EKS a continuellement évolué, déployant plus de 250 fonctionnalités pour alléger la charge des équipes techniques. Historiquement, AWS s'est d'abord concentré sur la gestion du Control Plane, avant d'innover sur le Data Plane (nœuds hébergeant les conteneurs applicatifs) et, plus récemment, sur les outils opérationnels. Cette évolution s'est matérialisée par des étapes clés :

- Les Add-ons (2020) : L'intégration de plugins directement gérés tel que CoreDNS, VPC-CNI …, pour simplifier le déploiement des briques logicielles du cluster.

- EKS Auto Mode (fin 2024) : Une avancée majeure qui délègue encore plus de responsabilités à AWS en gérant à la fois le plan de contrôle, les plugins et la mise à l'échelle automatique des nœuds de calcul, libérant ainsi un temps précieux pour les opérateurs. Les nœuds sont alors managés par AWS, mais apparaissent dans le compte de l’utilisateur.

Pour en savoir plus sur EKS Auto Mode, voir la source

Répondre aux contraintes opérationnelles : Les améliorations clés

Afin de fluidifier l'utilisation d'EKS et répondre aux frictions historiques, plusieurs solutions de gouvernance et d'observabilité ont été renforcées récemment :

- La gestion des coûts : La mutualisation des ressources complique l'attribution des factures. Pour y remédier, la fonctionnalité SCAD (Split Cost Allocation Data) permet désormais de ventiler les coûts directement dans le fichier Cost and Usage Report (CUR) d'AWS, en se basant sur l'utilisation des vCPU, de la RAM, et depuis peu, des GPU et des labels personnalisés.

- Les mises à jour sécurisées : L'outil Cluster Upgrade Insights permet aujourd'hui de lancer des vérifications à la demande et bloque automatiquement les mises à jour si des API dégradées ou incompatibles sont détectées, évitant ainsi les casses en production.

- L'observabilité réseau et globale : Un nouveau tableau de bord global offre une vue unifiée de tous les clusters à l'échelle de l'organisation (multi-comptes et multi-régions), facilitant le repérage des clusters en support étendu. De plus, le nouvel agent Network Flow Monitor offre une topologie de service visuelle et des tables de flux directement dans la console EKS pour investiguer rapidement les pannes réseau.

- La résilience : Pour prévenir la perte de données (ou la suppression accidentelle de cluster), EKS intègre nativement AWS Backup, permettant de sauvegarder sans agent la configuration complète, les ressources et les volumes persistants d'un cluster.

Les grandes nouveautés EKS : Plateformes managées et Intelligence Artificielle

Le contexte actuel est doublement marqué par l'essor de l'ingénierie de plateforme (Platform Engineering) et l'explosion de l'Intelligence Artificielle. AWS répond à ces deux axes avec des annonces majeures.

1. EKS Capabilities : L'accélérateur de plateformes Sorti fin d'année dernière lors de l'événement re:Invent, EKS Capabilities est un ensemble de fonctionnalités managées par AWS visant à simplifier la construction de plateformes de développement. Il s'articule autour de trois piliers :

- Argo CD : L'outil standard du marché pour le GitOps, désormais fourni en service managé pour garantir que l'état du cluster correspond en permanence à la source de vérité déclarée dans Git, évitant ainsi les dérives (drifts).

- ACK (Amazon Controllers for Kubernetes) : Permet aux développeurs de provisionner des ressources AWS tel que des buckets S3 ou des bases de données RDS directement via des manifestes YAML de Kubernetes.

- KRO (Custom Resource Orchestrator) : Permet aux équipes de plateforme de combiner plusieurs ressources en une seule API personnalisée, en y intégrant des garde-fous, par exemple: limiter le nombre de réplicas, pour simplifier et sécuriser le déploiement par les développeurs.

2. Le support massif de l'IA D'ici 2028, AWS estime que 95 % des déploiements d'intelligence artificielle s'exécuteront sur Kubernetes. Pour accompagner cette tendance, EKS introduit de nouvelles capacités de mise à l'échelle :

- Ultra Scale Cluster : Conçu pour des acteurs comme Anthropic, cette fonctionnalité repousse les limites en supportant jusqu'à 100 000 nœuds (soit 800 000 GPU Nvidia) dans un seul et même cluster. La limite étant de 5000 nœuds par cluster, AWS a donc modifier la base ETCD du service EKS pour augmenter cette limite. Pour plus d’informations, voir l'article dédié à ce changement sur le blog AWS

- Provisioned Control Plane : Permet d'anticiper les pics de charge (modèles d'IA, gros événements web) en provisionnant à l'avance et à la demande un plan de contrôle de plus grande capacité, sans passer par un ticket support.

- SOCI (Seekable Open Container Initiative) : Accélère le démarrage des très lourds conteneurs d'IA en parallélisant le téléchargement des images et en démarrant l'application avant même que l'image complète ne soit rapatriée.

- EKS MCP Manager : Un serveur managé qui s'intègre avec les IDE et les assistants IA (comme Amazon Q) pour fournir de l'aide et de la traçabilité directement au cœur des outils de développement pour le service AWS EKS.

AWS Summit 2026 : Annonces des nouveautés EKS

Aujourd'hui, près de 94 % des entreprises utilisent Kubernetes en production, en phase d'évaluation ou de test. Cet engouement massif s'explique par trois atouts majeurs : la simplicité de l'orchestration des conteneurs, la portabilité permettant d'exécuter ses charges de travail partout (cloud, on-premise, en local), et une forte extensibilité.

Cependant, utiliser Kubernetes au quotidien impose des contraintes opérationnelles fortes : complexité de l'installation, difficulté de suivi des coûts mutualisés, gestion fastidieuse des mises à jour et résolution de problèmes réseau. Pour répondre à ces défis contextuels, le service Amazon EKS a été conçu pour simplifier l'exploitation tout en s'engageant à fournir une version toujours native et totalement compatible de Kubernetes.Dans les années à venir, AWS souhaite pousser l'abstraction à son paroxysme. L'objectif final est de faire disparaître totalement la notion de "gestion de cluster" pour les développeurs, afin qu'ils puissent se concentrer uniquement sur le déploiement de leurs manifestes et de leurs applications, dans une expérience de développement totalement fluide et transparente.

La donnée : optimiser à grande échelle

Apache Iceberg et Amazon S3

Cette session rappelle que la data reste un pilier.

Points marquants :

- S3 Tables pour simplifier la gestion

- importance du monitoring

- KPIs avancés (skew, distribution)

👉 La performance et les coûts dépendent directement de la qualité de la structuration des données.

Optimiser l’IA en production : performance et coûts

Maîtriser l’inférence LLM avec SageMaker

Déployer un modèle ne suffit plus : il faut l’optimiser.

Plusieurs leviers clés ont été présentés :

Mutualisation des ressources

- Multi-Model Endpoints

- auto-scaling avec cache

Routage intelligent

- load-aware

- session-aware

Optimisation du moteur

- vLLM et KV cache

- meilleure gestion du throughput

Réduire les coûts drastiquement

Plusieurs techniques permettent des gains spectaculaires :

- Quantisation (AWQ) → réduction mémoire

- LoRA → fine-tuning léger

- Speculative decoding → accélération

👉 Résultat : jusqu’à -90 % de coûts

L’IA au service des médias : vers le temps réel

AWS Elemental Inference

AWS introduit une approche nouvelle : intégrer l’IA directement dans le pipeline vidéo.

Fonctionnalités clés :

- analyse en temps réel (6 à 10 secondes de latence)

- génération automatique de formats verticaux

- détection et extraction des moments forts

Cas d’usage :

- clips générés instantanément

- diffusion optimisée pour mobile

- engagement maximisé

👉 L’IA devient invisible, intégrée directement dans l’infrastructure.

Cas d’usage : IA et prise de décision

Un exemple intéressant côté métier : le PMU.

Plutôt que de prédire un gagnant, l’IA :

- analyse historique, contexte et variables en temps réel

- calcule un score de fiabilité

- informe sur le niveau de risque

👉 Une approche plus transparente et plus utile pour l’utilisateur final.

Conclusion

Ce AWS Summit 2026 met en lumière une évolution profonde de notre métier.

Trois grandes dynamiques se dégagent :

- l’IA devient un acteur à part entière, capable d’écrire, corriger et opérer

- les plateformes abstraient la complexité, avec Kubernetes en pilier central

- la souveraineté devient un paramètre de design, et non plus une contrainte

Dans ce contexte, le rôle des équipes évolue :

👉 moins d’exécution👉 plus d’orchestration👉 plus de décisions structurantes

Finalement, comme le suggérait la conférence sur la requête HTTP, il ne s’agit plus de tout maîtriser… mais de savoir où apporter de la valeur.

- Le partenariat Ippon avec AWS

- AWS European Sovereign Cloud : Repenser la souveraineté numérique dans le cloud public

- Spec-Driven Development (SDD) : de la spécification au code avec l’IA (exemple complet avec Kiro)

- AWS Re:Invent 2025: les news dont on ne parle pas assez!