L'édition 2026 de Touraine Tech a été l'occasion, comme chaque année, d'apporter de nouveaux points de vue sur de nombreux sujets. Contexte actuel oblige, cette édition était placée sous le signe de la souveraineté numérique, de la sécurité des données et de l'intelligence artificielle, cette dernière ayant beaucoup gagné en maturité ces deux dernières années. Outre ces sujets d'actualités, nous avons pu assister à de nombreuses conférences techniques ou non-techniques, parfois inattendues : vous saviez que PostgreSQL possédait une extension d'anonymisation de données, que PHP était en fait un langage web moderne ou qu'il est possible de créer une machine de Turing dans le jeu Factorio ? Nous avons résumé pour vous plusieurs de ces conférences qui nous ont marqués.

Les Agents : l'ordre dans le chaos des IA

De Thierry Chantier

Développeur Advocate chez Dataiku

Peut-on organiser des agents IA de façon à créer un système informatique qui soit expert dans plusieurs domaines ? Dans sa conférence, Thierry Chantier nous a exposé le principe de système multi-agents et comment les mettre en place.

Le principe est simple : chaque agent, configuré par des prompts, décide dynamiquement quel pair solliciter en fonction de la tâche, juge la pertinence des réponses de ses pairs et crée une réponse au bon format en conséquence. Les architectures possibles peuvent être nombreuses, comme les problèmes qui peuvent arriver si, par exemple, deux agents s'appellent en boucle.

La démonstration nous a montré ce que pouvait donner un tel système pour un restaurant virtuel, implémenté avec CrewAI. Un chef propose un menu et demande ensuite à un sommelier de conseiller un vin pour accompagner le menu. Le système, branché à GPT4-mini répond alors à un client (humain) qui demande un menu selon ses préférences. Résultat ? Des réponses parfois peu pertinentes à cause, entre autres, du désaccord entre agents.

Heureusement, CrewAI offre une fonctionnalité cruciale : la visualisation des interactions entre agents. Cela permet d’identifier les blocages, les boucles, ou d'autres problèmes, et de mettre au jour un phénomène inattendu : l’impact de la langue sur la cohérence des réponses. En français, les agents peinent à se mettre d’accord (le sommelier et le chef étaient en conflit sur le vin à conseiller), tandis qu’en anglais, les désaccords disparaissent. Il faut dire que les LLM sont entraînés sur les comportements des humains, y compris ceux des français.

Une conférence très intéressante qui nous a rappelé que les agents IA, comme le vin, sont à consommer avec modération. Les systèmes multi-agents sont une belle promesse, mais qui repose sur une technologie encore trop imprévisible pour une utilisation en production.

Serveurs MCP au-delà des bases : bonnes pratiques, choix de conception et leurs conséquences

De Horacio Gonzalez

Head of RelDev chez CleverCloud

Afin de rendre la technologie d'agent IA plus prévisible, on peut utiliser un serveur MCP (Model Context Protocol) : une façon pragmatique d'utiliser un LLM pour le faire interagir avec une API.

Le MCP consiste à utiliser un LLM pour communiquer en langage naturel un ensemble d'instructions qui sera ensuite traduit vers des appels de fonctions standards définis à l'avance. Attention cependant aux implémentations naïves. Par exemple, le serveur MCP fourni par PostgreSQL peut exécuter n'importe quelle requête SQL sur la base de données sur demande du LLM, qu'est-ce qui pourrait mal se passer ?

Les serveurs MCP sont aujourd'hui encore jeunes mais possèdent un fort potentiel pour créer un pont entre le langage des humains et le langage des ordinateurs. Il est d'ailleurs assez simple de les mettre en place grâce à des frameworks comme Spring AI ou FastMCP, mais en gardant à l'esprit qu'il faut une certaine discipline lors de leur conception et de leur implémentation.

Pour aller plus loin, Horacio Gonzalez a écrit un article consacré au sujet sur son blog : Comprendre les serveurs MCP : approches génériques ou spécifiques au domaine.

Handicap invisible : l’accessibilité commence dans les réunions (et l'IA peut aider)

De Anaïs Moulin

Product Owner chez Ippon Technologies

Dans sa conférence, notre collègue d'Ippon Technologies nous a présenté un sujet crucial en entreprise : celui du handicap, rappelant qu'une personne sur sept souffre d'un handicap invisible en France, que ce handicap soit sensoriel, moteur, mental ou psychique.

Qu'il s'agisse de problèmes d'attention, d'audition ou autre, de nombreuses personnes ont des difficultés quotidiennes à suivre les réunions avec leurs collègues pour diverses raisons : mauvaise qualité du son, débit de parole trop élevé, absence d'ordre du jour ou de compte-rendu.

Heureusement, l'accessibilité peut être atteinte par des pratiques simples à mettre en place, éventuellement assistées d'outils informatiques. Créer un ordre du jour, organiser la prise de parole, mettre sa webcam pour améliorer le non-verbal ou se forcer à répéter les questions nécessite un effort humain, mais les outils de vidéoconférence modernes intègrent aujourd'hui une génération de sous-titres instantanés, ainsi qu'une création de compte-rendu de réunions automatique grâce à l'IA générative.

Ces habitudes, si elles peuvent sembler anecdotiques, aident vraiment les personnes en situation de handicap et améliorent grandement la communication au sein des équipes, y compris pour les personnes valides ! Après tout, la bonne entente, au sens propre comme au sens figuré, est la base d'une équipe efficace.

Diátaxis : ne perdez plus vos lecteurs, devenez intentionnel dans votre documentation

De Alexis "Horgix" Chotard

Ingénieur consultant DevOps chez Xebia

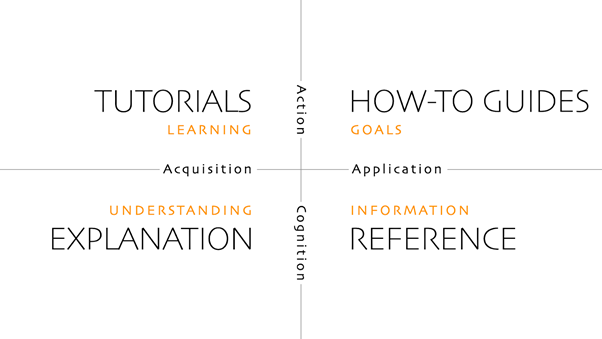

La documentation est souvent redoutée, parfois au moment de la consulter, souvent au moment de la rédiger. C’est fastidieux à écrire, et parfois difficile à lire. Lors de son dernier talk, Alexis Chotard nous a présenté Diátaxis, un framework visant à rédiger une doc claire, concise, pratique à utiliser et par conséquent beaucoup plus maintenable.

Diátaxis divise la documentation en quatre piliers distincts : des tutoriels pour apprendre, des guides pratiques en définissant des objectifs, des explications pour comprendre et des références pour l’information.

Les tutoriels pour apprendre par la pratique : C’est l’introduction de la documentation. Ils guident les débutants sans rentrer dans les détails techniques. C’est aussi l’endroit pour citer des erreurs classiques de débutant et comment les résoudre.

Les guides pratiques pour atteindre un objectif : Ces guides répondent à la question “comment faire ceci ?”. En une série d’étapes claires, le lecteur est guidé jusqu’à son objectif clairement indiqué dans le titre de l’article de documentation.

Les explications pour comprendre pourquoi : Ces articles de documentations permettent d’expliquer les concepts, les enjeux, la philosophie de l’outil.

Les références pour apprendre : Les références permettent de définir des termes, de dessiner des schémas techniques, etc. L’objectif est de donner des informations précises pour des lecteurs qui cherchent exactement cette information, sans justification ni explication.

Une documentation rédigée selon le framework Diátaxis permet d’obtenir des articles faciles à rédiger et à lire, dont la navigation est facilitée et naturelle, et dont la maintenance est beaucoup plus aisée.

Enfin, Alexis nous donne deux conseils de pro pour conclure sa conférence :

- Soyez spécifiques : choisissez des titres d’articles clairs et exhaustifs pour éviter les titres flous.

- Découpez vos articles et croisez les références : n’hésitez pas à ajouter des liens entre vos articles pour éviter les informations redondantes. C’est aussi l’occasion de référencer de la documentation officielle externe.

Prêt à mettre en œuvre Diátaxis dans votre labyrinthique Confluence ?

La face cachée de la performance des équipes de développements

De Geoffrey Gravaud

Coach Dev Experience, Performance, Craft, Accelerate, DevOps chez Inside

Un talk qui traite de l’expérience développeur au global : qu’est-ce qui nous ralentit au quotidien ? Qu’est-ce qui sabote notre engagement ? Quels sont les impacts sur notre mémoire ou notre performance ?

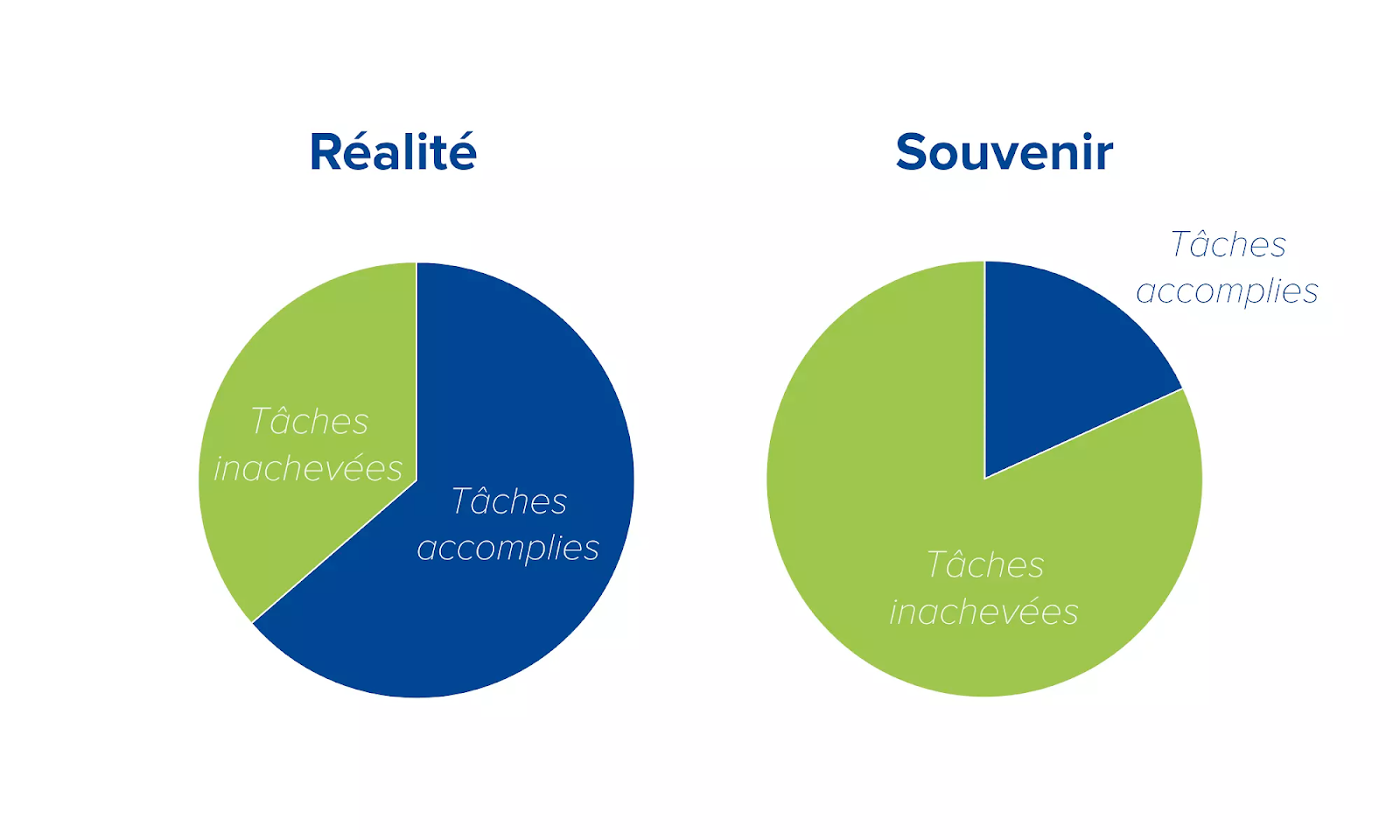

Geoffrey aborde l’effet Zeigarnik : notre capacité à nous rappeler plus souvent les tâches inachevées que complétées.

La mise en situation était percutante : êtes-vous déjà rentrés chez vous, avez-vous déjà démarré votre “après-travail” et puis soudain, vous tenez la solution de la tâche qui vous bloquait quelques heures auparavant. C’est ce genre de situations qui provoquent le cercle vicieux fatigue → retard au travail → plus de tâche → plus de tâches à traiter → fatigue.

Au-delà des aspects de santé et de psychologie, Geoffrey indique quelques clés pour optimiser notre travail : essayer de mettre en place des “focus day”, c'est-à-dire des journées sans réunion / sans interruption. Ou a minima des créneaux sacralisés dans la semaine de travail 100% focus. Il aborde le concept de Flow qui est notamment développé dans Deep Work de Cal Newport.

En résumé, c’était un sujet sympa, avec une bonne prestation oratoire… et une recommandation géniale d’un livre 100% DevEx : Frictionless de Nicole Forsgen et Abi Noda.

Metal-as-a-Service : Gérer votre bare-metal comme si c'était une machine virtuelle !

De Julien Briault

Ingénieur Réseau / SRE chez Deezer & Manager d’infrastructure bénévole aux Restos du Cœur

Des mots qui sonnent doux à l'oreille de tout administrateur infra.

L'idée de base : créer une infrastructure avec des ressources physiques à la demande, comme peuvent le faire les fournisseurs de Cloud à grande échelle. Les Restos du cœur hébergent eux même leur infrastructure multi-sites, administrent un Cloud propulsé par OpenStack, et proposent une gamme de service quasi-complète avec une philosophie "tout est API".En bref, un cloud privé haut de gamme comme nos clients en hébergent parfois.

Alors comment réaliser ce tour de force quand on est une telle association ? En se reposant uniquement sur du logiciel Open Source, le héros intemporel de l'informatique.

Aux Restos on utilise l’outil MaaS de Canonical. C'est lui qui sera la pierre angulaire pour gérer les serveurs physiques à la demande. Il permet notamment d'allumer, d'éteindre et de booter des machines via les composants matériels intégrés.

Mais en réalité ce n'est pas le seul outil nécessaire au déploiement complet des serveurs. Il faudra curtin pour installer le système d'exploitation et cloud-init pour le configurer à chaque démarrage. A ce stade, nous sommes déjà capable de visualiser et de contrôler notre parc et nos pools de serveurs.

Les API de MaaS permettent d'interfacer la supervision, l’alerting ou même la source de vérité. Grâce à un outil supplémentaire il sera même possible d’automatiser le provisionnement des machines selon diverses métriques, comme la consommation énergétique.

Et voilà une scalabilité automatique qui allège à la fois les coûts, l’impact environnemental et la charge de maintenance.

Si ces problématiques nous parlent, c'est parce que cela répond exactement à un sujet majeur et actuel : une approche souveraine du Cloud sans concession sur les fonctionnalités.

Au Restos du Cœur, quelques bénévoles administrent un Cloud privé. Ils maîtrisent leurs services de bout en bout. Ils ne reposent que sur des technologies logicielles ouvertes. Ils ont automatisé le provisionnement. Cerise sur le gâteau, chaque euro économisé permettra de servir un repas supplémentaire.

Voilà une présentation inspirante qui est une preuve de ce qu'on peut accomplir techniquement lorsqu'on fait confiance aux compétences d'experts du domaine.

Révolution TanStack Query : Enfin une bonne gestion d’état

De Lucas Audart et Mickael Alves

Développeur Frontend chez Kolecto, Tech Lead Front chez Zenika

En développement web, le réseau est par nature imprévisible : latences, erreurs aléatoires ou mise en veille des onglets obligent souvent les développeurs à bricoler des mécanismes complexes pour maintenir une interface cohérente. Lors de leur conférence, Lucas Audart et Mickael Alves ont montré comment TanStack Query s'impose comme la solution pour stabiliser ce chaos.

Si des frameworks comme Angular ou SolidJS proposent désormais des mécanismes intégrés (les ressources), ceux-ci restent souvent verrouillés à leur écosystème et nécessitent une gestion manuelle fastidieuse des cas limites. C’est ici qu’intervient TanStack Query.

L'idée forte est d'insérer cette brique entre vos clients asynchrones (fetch, Axios) et votre interface. Ce médiateur décharge les composants et les stores de responsabilités superflues en gérant automatiquement le cycle de vie des données externes. On gagne ainsi une gestion d'état plus fine et moins dépendante des aléas du réseau.

L'impact pour l'utilisateur est immédiat :

- Fluidité : Le cache intelligent élimine les temps d'attente inutiles.

- Données fraîches : La synchronisation automatique au retour sur l'onglet garantit la pertinence des infos.

- Sentiment de rapidité : Les optimistic updates simulent une réponse instantanée du serveur.

- Fiabilité : Le support hors-ligne assure une continuité de service malgré les coupures.

Pour le développeur, les DevTools apportent une visibilité totale. Plus besoin de deviner l'état du cache ou de multiplier les logs : on voit en temps réel quelles données sont fraîches ou périmées, rendant le débogage enfin prédictible.

Super apps : on voulait un skateboard, on construit un porte-avion

De Baptiste Carlier et Antoine Robiez

Tech Lead Android chez Decathlon, Développeur senior Android chez Decathlon

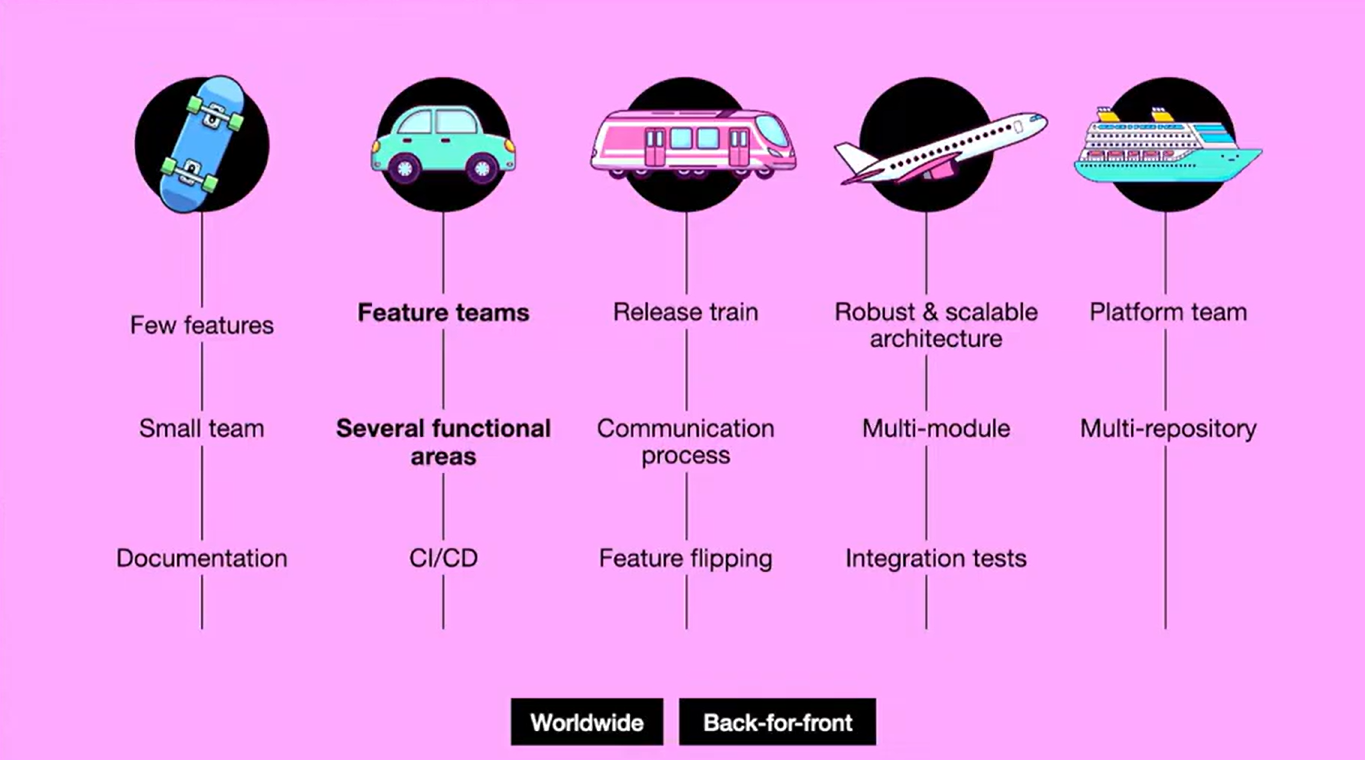

Dans ce talk, deux développeurs de chez Decathlon partagent leur retour d’expérience sur l’hypercroissance qu’ils ont vécue et expliquent comment les pratiques Craft et DevOps leur ont permis de la traverser.

Pour illustrer cette évolution, ils nous embarquent dans une métaphore filée autour de différents moyens de transport, dont la taille toujours plus grande permet d’accueillir une équipe en constante expansion.

Le skate

Au départ, ils travaillent dans une toute petite équipe : seulement deux développeurs sur une simple application. Le fonctionnement est léger, rapide, efficace. Peu de process, peu de contraintes : la communication est directe et la production fluide.

La voiture

Le business grandit, et il devient nécessaire d’augmenter la vélocité de production. La solution adoptée : recruter des développeurs et créer plusieurs équipes travaillant sur un même produit. C’est la naissance des feature teams.

Malgré la mise en place de la CI/CD, un problème survient : la synchronisation des équipes et la coordination des livraisons deviennent complexes.

Le train

Ils adoptent alors le Release Train, inspiré du framework SAFe, couplé à la mise en place du feature flipping. Les releases peuvent désormais être gérées de manière plus sereine, avec un meilleur alignement entre les équipes.

L’avion

L’application continue de croître. Pour gagner en robustesse, ils adoptent la règle des 4T : Testabilité, Maintenabilité, Scalabilité et Qualité Cela se traduit par l’adoption de la Clean Architecture, décrite par Robert C. Martin, ainsi que par un découpage de l’application en un grand nombre de modules indépendants (Gradle).

Cependant, ce découpage soulève une nouvelle difficulté : définir l’ownership de certains modules transverses (authentification, utils, réseau, etc.) n’est pas si simple.

Le paquebot

Bien que le titre de la conférence mentionnait un porte-avions, c’est finalement d’un paquebot dont ils ont parlé… un paquebot avec un P comme Platform Team !

Ce type d’équipe, que l’on retrouve notamment dans le livre Team Topologies, a pour mission de fournir aux autres équipes tout ce dont elles ont besoin pour gagner en efficacité, afin qu’elles puissent se concentrer pleinement sur la création de valeur métier.

Dans cette optique, la Platform Team qu’ils ont mise en place prend en charge de nombreux sujets, tels que la centralisation des outils et des pratiques, ainsi que la maintenance des librairies partagées.

Encore une fois, Touraine Tech nous a offert de super conférences pour cette 8ème édition. Toutes les rediffusions sont disponibles sur leur chaîne YouTube @tourainetech37. Ippon Technologies tient à remercier l'ensemble de l'équipe de Touraine Tech, des speakers et des speakerines pour l'accueil, l'organisation et la qualité des sujets présentés et espère que nous nous reverrons en 2027. À l’année prochaine !

Vous avez des besoins de transformation digitale ?

Nos consultants accompagnent vos équipes sur vos problématiques de souveraineté numérique, data ou ia.